創(chuàng)建ChatGPT的公司背后的首席執(zhí)行官認(rèn)為,,人工智能技術(shù)將重塑我們所知的社會,。他認(rèn)為它會帶來真正的危險(xiǎn),,但也可能是“人類迄今為止發(fā)展出的最偉大的技術(shù)”,,可以極大地改善我們的生活,。

“我們在這里必須小心,,” OpenAI首席執(zhí)行官薩姆奧特曼說,。“我認(rèn)為人們應(yīng)該為我們對此有點(diǎn)害怕而感到高興,。”

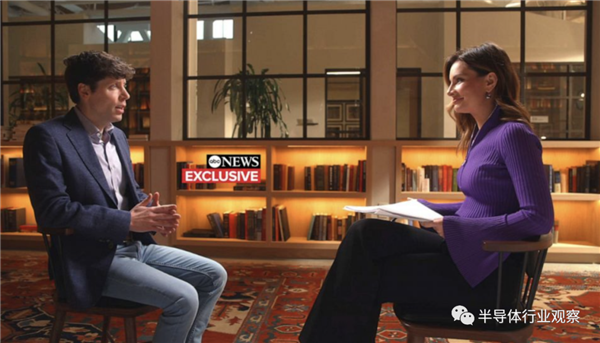

Altman 坐下來接受 ABC 新聞首席商業(yè)、技術(shù)和經(jīng)濟(jì)記者 Rebecca Jarvis 的獨(dú)家采訪,,談?wù)揋PT-4 的推出——AI 語言模型的最新版本,。

在接受采訪時(shí),Altman 強(qiáng)調(diào) OpenAI 需要監(jiān)管機(jī)構(gòu)和社會盡可能地參與 ChatGPT 的推出——堅(jiān)持認(rèn)為反饋將有助于阻止該技術(shù)可能對人類造成的潛在負(fù)面影響,。

他補(bǔ)充說,,他與政府官員保持“定期聯(lián)系”。

ChatGPT是一種AI語言模型,,GPT代表Generative Pre-trained Transformer,。

僅在幾個(gè)月前發(fā)布,它已被認(rèn)為是歷史上增長最快的消費(fèi)者應(yīng)用程序,。該應(yīng)用程序在短短幾個(gè)月內(nèi)就達(dá)到了 1 億月活躍用戶,。

相比之下,根據(jù)瑞銀的一項(xiàng)研究,,TikTok 用了九個(gè)月才達(dá)到這么多用戶,,而 Instagram 用了將近三年,。

雖然“不完美”,但根據(jù) Altman 的說法,,GPT-4 在統(tǒng)一律師考試中得分為第 90 個(gè)百分位,。它還在 SAT 數(shù)學(xué)測試中取得了近乎滿分的成績,現(xiàn)在它可以熟練地用大多數(shù)編程語言編寫計(jì)算機(jī)代碼,。

GPT-4 只是朝著 OpenAI 最終構(gòu)建通用人工智能的目標(biāo)邁出的一步,,即當(dāng) AI 跨越一個(gè)強(qiáng)大的閾值時(shí),這個(gè)閾值可以被描述為通常比人類更聰明的 AI 系統(tǒng),。

盡管他慶祝自己產(chǎn)品的成功,,但 Altman 承認(rèn) AI 可能的危險(xiǎn)實(shí)施讓他徹夜難眠。

“我特別擔(dān)心這些模型可能會被用于大規(guī)模的虛假信息,,”Altman說,。“現(xiàn)在他們在編寫計(jì)算機(jī)代碼方面做得越來越好,[他們] 可以用于攻擊性網(wǎng)絡(luò)攻擊,。”

Altman沒有分享的一個(gè)常見的科幻恐懼:不需要人類的人工智能模型,,它們自己做出決定并策劃世界統(tǒng)治。“它等待有人給它輸入,,”Altman說,。“這是一種非常受人類控制的工具。”

然而,,他說他確實(shí)擔(dān)心哪些人可以控制,。“會有其他人不設(shè)置我們設(shè)置的一些安全限制,”他補(bǔ)充說,。

“我認(rèn)為,,社會只有有限的時(shí)間來弄清楚如何對此做出反應(yīng),如何監(jiān)管,,如何處理,。”

2017 年開學(xué)第一天,俄羅斯總統(tǒng)弗拉基米爾·普京 (Vladimir Putin) 告訴俄羅斯學(xué)生,,無論誰在人工智能競賽中領(lǐng)先,,都可能“統(tǒng)治世界”。

“所以這肯定是一個(gè)令人不寒而栗的聲明,,”Altman說,。“相反,我希望的是,,我們不斷開發(fā)出越來越強(qiáng)大的系統(tǒng),,我們都可以以不同的方式使用這些系統(tǒng),將其融入我們的日常生活,融入經(jīng)濟(jì),,并成為人類意志的放大器,。”

對錯(cuò)誤信息的擔(dān)憂

根據(jù) OpenAI 的說法,GPT-4 與之前的迭代相比有了巨大的改進(jìn),,包括將圖像理解為輸入的能力,。演示展示了 GTP-4 描述某人冰箱里的東西、解決難題,,甚至闡明互聯(lián)網(wǎng)模因背后的含義,。

目前只有一小部分用戶可以使用此功能,包括參與 Beta 測試的一群視障用戶,。

但根據(jù) Altman 的說法,ChatGPT 等 AI 語言模型的一個(gè)持續(xù)問題是錯(cuò)誤信息:該程序可以為用戶提供事實(shí)上不準(zhǔn)確的信息,。“我最想提醒人們的是我們所說的‘幻覺問題’,,”Altman說。“該模型會自信地陳述事物,,就好像它們是完全虛構(gòu)的事實(shí)一樣,。”

根據(jù) OpenAI 的說法,該模型存在這個(gè)問題,,部分原因是它使用演繹推理而不是記憶,。

OpenAI 首席技術(shù)官 Mira Murati 告訴美國廣播公司新聞:“我們從 GPT-3.5 到 GPT-4 看到的最大差異之一是這種新興的更好推理能力。”

“我們的目標(biāo)是預(yù)測下一個(gè)詞——由此,,我們看到了對語言的理解,,”Murati 說。“我們希望這些模型能像我們一樣看待和理解世界,。”

“考慮我們創(chuàng)建的模型的正確方法是推理引擎,,而不是事實(shí)數(shù)據(jù)庫,”Altman 說,。“它們也可以充當(dāng)事實(shí)數(shù)據(jù)庫,,但這并不是它們的特別之處——我們希望它們做的是更接近于推理能力,而不是記憶能力,。”

Altman 和他的團(tuán)隊(duì)希望“隨著時(shí)間的推移,,這個(gè)模型將成為這個(gè)推理引擎,”他說,,最終能夠使用互聯(lián)網(wǎng)和它自己的演繹推理來區(qū)分事實(shí)和虛構(gòu),。

根據(jù) OpenAI 的說法,GPT-4 產(chǎn)生準(zhǔn)確信息的可能性比其之前的版本高 40%,。

盡管如此,,Altman表示,依賴該系統(tǒng)作為準(zhǔn)確信息的主要來源“是你不應(yīng)該使用它的地方”,并鼓勵(lì)用戶仔細(xì)檢查程序的結(jié)果,。

防范不良行為者

ChatGPT等AI語言模型所包含的信息類型也一直備受關(guān)注,。例如,ChatGPT 是否可以告訴用戶如何制造炸彈,。

根據(jù) Altman 的說法,,答案是否定的,因?yàn)榫幋a到 ChatGPT 中的安全措施,。

“我擔(dān)心的一件事是……我們不會成為這項(xiàng)技術(shù)的唯一創(chuàng)造者,,”奧特曼說。“會有其他人不對我們施加的一些安全限制加以限制,。”

根據(jù) Altman 的說法,,針對 AI 的所有這些潛在危害,有一些解決方案和保護(hù)措施,。其中之一:讓社會在風(fēng)險(xiǎn)較低的時(shí)候玩弄 ChatGPT,,并學(xué)習(xí)人們?nèi)绾问褂盟?/p>

Murati 表示,目前,,ChatGPT 向公眾開放主要是因?yàn)?ldquo;我們正在收集大量反饋”,。

隨著公眾繼續(xù)測試 OpenAI 的應(yīng)用程序,Murati 表示,,識別需要保護(hù)措施的地方變得更加容易,。

“人們用它們做什么,還有它的問題是什么,,缺點(diǎn)是什么,,以及能夠介入 [和] 改進(jìn)技術(shù),”Murati 說,。Altman 表示,,讓公眾與每個(gè)版本的 ChatGPT 進(jìn)行互動(dòng)非常重要。

“如果我們只是秘密地開發(fā)這個(gè)——在我們這里的小實(shí)驗(yàn)室里——然后制造出 GPT-7,,然后一下子把它投放到世界上……我認(rèn)為,,這是一個(gè)有更多不利因素的情況,”

Altman 說,。“人們需要時(shí)間來更新,、做出反應(yīng)、習(xí)慣這項(xiàng)技術(shù),,[并]了解缺點(diǎn)在哪里以及可以采取哪些緩解措施,。”

關(guān)于非法或道德上令人反感的內(nèi)容,Altman 表示他們在 OpenAI 有一個(gè)政策制定者團(tuán)隊(duì),,他們決定將哪些信息輸入 ChatGPT,,以及允許 ChatGPT 與用戶共享哪些信息,。

“[我們]正在與各種政策和安全專家交談,對系統(tǒng)進(jìn)行審計(jì),,試圖解決這些問題,,并推出我們認(rèn)為安全和好的東西,”Altman 補(bǔ)充道,。“再一次,,我們不會在第一次就做到完美,但吸取教訓(xùn)并在風(fēng)險(xiǎn)相對較低的情況下找到優(yōu)勢非常重要,。”

人工智能會取代工作嗎,?

這項(xiàng)技術(shù)的破壞性能力令人擔(dān)憂的是工作的替代。Altman 說這可能會在不久的將來取代一些工作,,并擔(dān)心這會發(fā)生多快,。

“我認(rèn)為經(jīng)過幾代人的努力,人類已經(jīng)證明它可以很好地適應(yīng)重大技術(shù)變革,,”Altman 說,。“但如果這種情況發(fā)生,你知道,,在個(gè)位數(shù)的年數(shù)中,其中一些轉(zhuǎn)變,,這是我最擔(dān)心的部分,。

但他鼓勵(lì)人們更多地將 ChatGPT 視為一種工具,而不是替代品,。他補(bǔ)充說,,“人類的創(chuàng)造力是無限的,我們找到了新的工作,。我們找到了新的事情要做,。”

“我認(rèn)為在幾代人的時(shí)間里,人類已經(jīng)證明它可以很好地適應(yīng)重大技術(shù)變革,,”Altman 說,。“但如果這種情況發(fā)生在個(gè)位數(shù)年內(nèi),其中一些轉(zhuǎn)變......這是我最擔(dān)心的部分,。”

根據(jù) Altman 的說法,,ChatGPT 可以用作人類工具的方式超過了風(fēng)險(xiǎn)。

Altman說:“我們都可以在口袋里擁有一位為我們量身定制的不可思議的教育者,,它可以幫助我們學(xué)習(xí),。” “我們可以為每個(gè)人提供超出我們今天所能獲得的醫(yī)療建議。”

ChatGPT 作為“副駕駛”

在教育領(lǐng)域,,ChatGPT 引起了爭議,,因?yàn)橐恍W(xué)生用它來作弊。教育工作者對這是否可以作為他們自己的延伸,或者是否會阻礙學(xué)生自學(xué)的動(dòng)力感到困惑,。

Altman說:“教育將不得不改變,,但隨著技術(shù)的發(fā)展,這種情況已經(jīng)發(fā)生了很多次,,”他補(bǔ)充說,,學(xué)生將能夠擁有一種超越課堂的老師。“讓我最興奮的其中一個(gè)是提供個(gè)人學(xué)習(xí)的能力——為每個(gè)學(xué)生提供很好的個(gè)人學(xué)習(xí),。”

在任何領(lǐng)域,,Altman 和他的團(tuán)隊(duì)都希望用戶將 ChatGPT 視為“副駕駛”,即可以幫助您編寫大量計(jì)算機(jī)代碼或解決問題的人,。

奧特曼說:“我們可以為每一個(gè)職業(yè)都做到這一點(diǎn),,我們可以擁有更高質(zhì)量的生活,比如生活水平,。” “但我們也可以擁有我們今天甚至無法想象的新事物——所以這就是承諾,。”

文章出處:半導(dǎo)體行業(yè)觀察